Dit is waarom AI bij de één explodeert en bij de ander faalt

Iedere organisatie wil iets met AI: chatbots, copilots, agents, content, analyse, automatisering. De belofte is groot, maar de praktijk is weerbarstig. Veel AI-initiatieven leveren minder op dan gehoopt. Soms zelfs helemaal niets.

Dat is geen kwestie van pech. Dat is een kwestie van ontwerp.

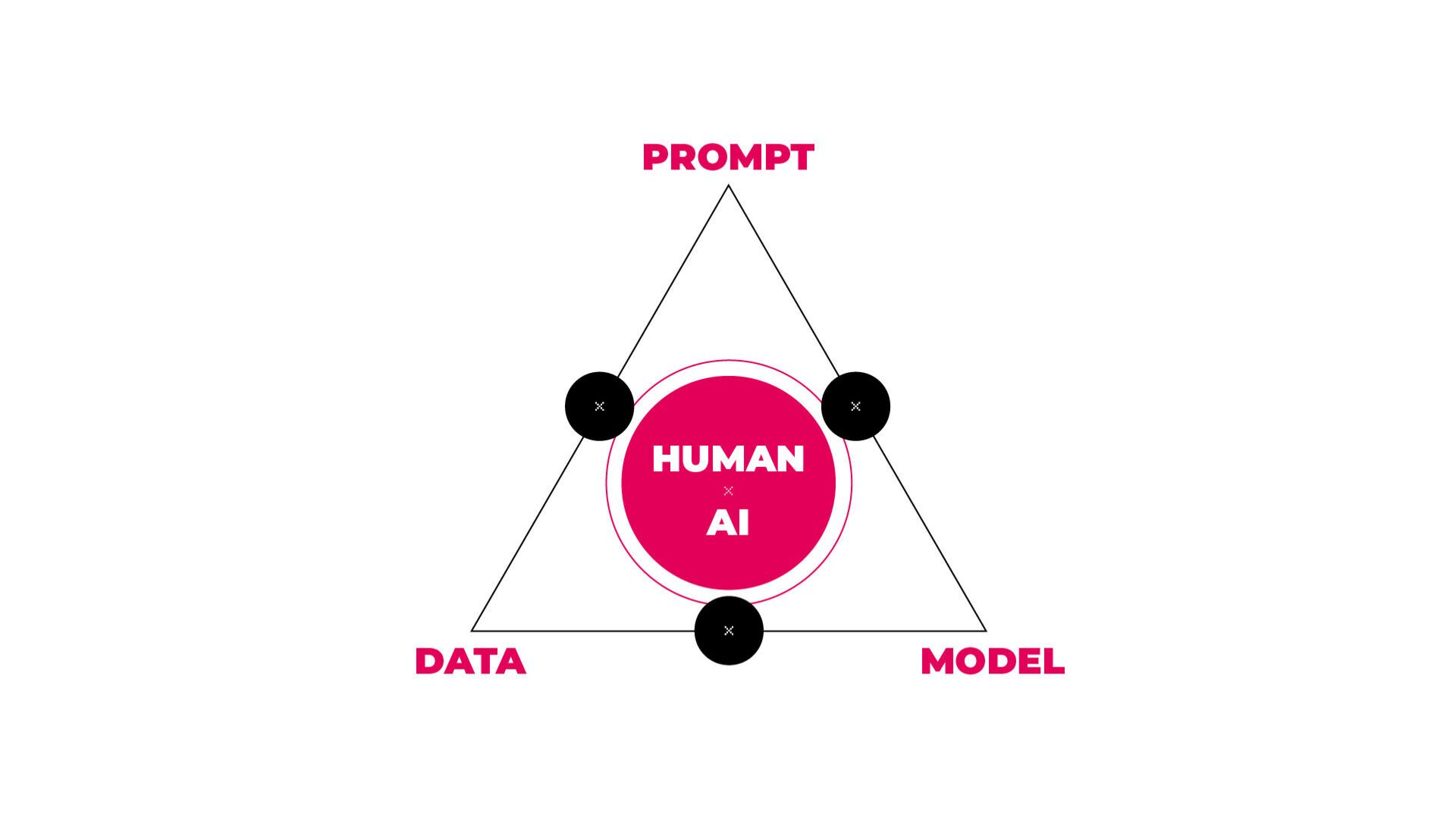

Wij kijken daarom niet naar AI als tool, maar als systeem. En dat systeem volgt altijd dezelfde formule:

Prompt × Data × Model = AI-resultaat

Deze drie vormen samen een driehoek. Ze zijn onlosmakelijk met elkaar verbonden. Als één onderdeel niet klopt, zakt het hele bouwwerk in elkaar.

Waarom AI vaak teleurstelt

Wat we in de praktijk zien:

- Er wordt gewerkt met een krachtig model, maar zonder duidelijke instructies

- Er wordt AI losgelaten op data die verouderd, incompleet of ongevalideerd is

- Er wordt gekozen voor het grootste model, terwijl een kleiner model beter past

- Of AI wordt gezien als vervanging van mensen in plaats van versterking

Het gevolg: onbetrouwbare output, trage systemen, niet gewenste resultaten en vooral frustratie in teams en verlies van vertrouwen in AI.

De drie keuzes die alles bepalen

1. Het juiste model, niet per se het grootste

Er is vandaag keuze uit gesloten modellen zoals GPT en Gemini, maar ook uit open source modellen zoals Mistral, LLaMA en Gemma. Die laatste kun je draaien in je eigen cloud of zelfs volledig on premise (binnen de muren van jouw organisatie)

Dat betekent:

- Meer controle over data

- Meer grip op kosten

- Meer mogelijkheden voor maatwerk

- En vaak betere performance op specifieke taken

AI volwassen inzetten betekent niet blind kiezen voor wat populair is, maar strategisch kiezen voor wat past bij jouw use case.

Meer over het Europese AI-model Mistral

2. Data als strategisch kapitaal

AI zonder data is leeg. Maar AI met verkeerde data is gevaarlijk.

De waarheid is simpel:

De kwaliteit van je data is de kwaliteit van je beslissingen.

Daarom bouwen wij AI-oplossingen vrijwel altijd rondom een eigen AI-database (een vectordatabase). Een slimme database die begrijpt wat relevant is voor welke taak. Niet zoeken op woorden, maar op betekenis.

Cruciaal daarbij is menselijke validatie. Niet alles wat bestaat mag zomaar in de database. Teams bepalen samen:

- Wat klopt

- Wat actueel is

- Wat gebruikt mag worden

- En wat expliciet niet

Dat maakt het verschil tussen een aardige demo en een AI-systeem dat je organisatie echt verder helpt.

3. Prompt als regielaag

De prompt is geen vraag, maar beleid.

Hier leg je vast:

- Gedrag

- Tone of voice

- Verantwoordelijkheden

- Grenzen (guardrails). Dus wat AI niet mag doen

Zeker bij AI-agents die processen aansturen, is dit essentieel. Zonder guardrails ontstaat risico. Met goede prompts ontstaat schaal.

Mens × AI. Waar de echte waarde zit

In het midden van onze formule staat daarom altijd:

Mens × AI

Niet omdat AI tekortschiet, maar omdat autonomie zonder verantwoordelijkheid nooit schaalbaar is.

De mens:

- Ontwerpt het systeem

- Valideert de data

- Bewaakt de context

- En blijft eindverantwoordelijk

AI:

- Verwerkt sneller

- Denkt consistenter

- Schaalt zonder vermoeidheid

- En maakt complexe systemen behapbaar

Samen vormen ze een superkracht.

AI is geen tool. Het is infrastructuur.

Organisaties die AI succesvol inzetten, doen drie dingen anders:

- Ze ontwerpen bewust hun AI-architectuur

- Ze investeren in data en validatie

- Ze positioneren de mens als regisseur, niet als eindgebruiker

Dat is precies waar wij organisaties bij helpen. Niet met losse tools, maar met een samenhangend AI-systeem dat werkt in de praktijk, schaalbaar is en past bij jouw organisatie.

Wil je AI die echt waarde levert. Dan begint het hier. Bij de formule.